Inteligencia Artificial

La inteligencia artificial (IA) ha dado un paso más allá en la transformación de la atención al cliente, evolucionando de simples automatizaciones a sistemas capaces de detectar emociones y comprender el contexto de las interacciones humanas. Los nuevos agentes de IA no solo automatizan tareas, sino que también ofrecen una atención más humana y personalizada.

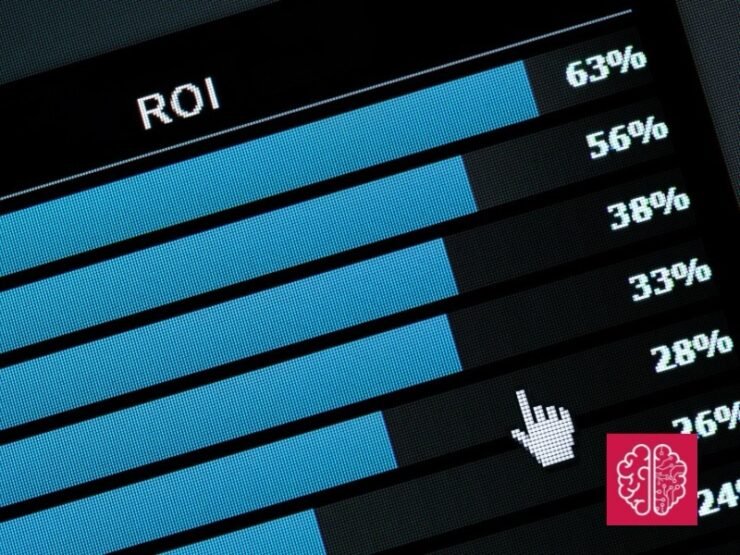

La IA ha revolucionado la calificación de leads, asignando puntuaciones automáticamente según la probabilidad de conversión de cada prospecto. Mediante modelos predictivos de machine learning entrenados con datos históricos de clientes convertidos y no convertidos, es posible predecir qué nuevos leads tienen más chances de volverse clientes. Estas soluciones analizan múltiples factores (interacciones con la web, apertura de emails, tamaño de empresa, sector, etc.) y otorgan un score en tiempo real a cada lead. A diferencia de los sistemas estáticos basados en reglas simples, los modelos de IA aprenden continuamente y ajustan sus predicciones conforme entran nuevos datos. Por ejemplo, “las herramientas de IA pueden determinar la probabilidad de que un cliente potencial se convierta en función de sus interacciones con tu marca”, lo que permite al equipo enfocarse en los prospectos más prometedores. Implementar este lead scoring predictivo agiliza la priorización: los vendedores se centran en leads de alta puntuación (mayor valor) mientras que la nurturación automática continúa con los de menor puntaje. Empresas líderes ya integran estos sistemas en sus CRM para filtrar miles de leads diarios de forma autónoma.

La Inteligencia Artificial está revolucionando la forma de vender en todos los sectores. En 2025, comprender cómo la IA transforma las ventas y la comunicación se ha convertido en una competencia profesional clave. Por ello, THE INTELLIGENCE Institute anuncia el lanzamiento de “Técnicas de Venta con Inteligencia Artificial”, presentado como el curso más avanzado en español sobre esta materia y diseñado para emprendedores, vendedores, autónomos y profesionales que quieren dominar el nuevo juego comercial.

El programa tiene una duración de 10 semanas (con una dedicación estimada de 5-7 horas semanales) y se impartirá en formato online, con grupos reducidos de hasta 30 participantes para garantizar una atención personalizada. A diferencia de otras formaciones, este curso no requiere conocimientos técnicos previos, lo que amplía su accesibilidad a profesionales de cualquier perfil. Además, cuenta con un precio especial de lanzamiento de 1.890€ (rebajado desde 2.550€) para las primeras promociones de alumnos inscritos. Asimismo, al estar THE INTELLIGENCE Institute inscrito como centro de formación en el registro estatal, la matrícula puede ser bonificada a través de FUNDAE, permitiendo que las empresas financien total o parcialmente el curso mediante créditos de formación.

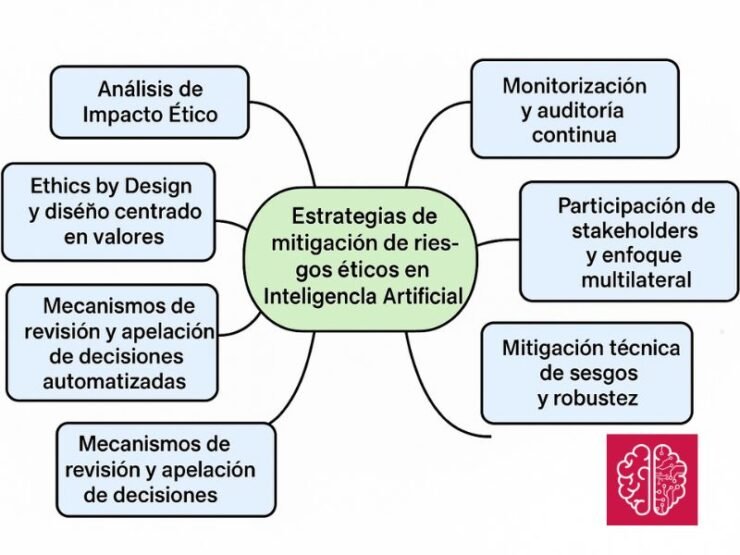

Hacia una Inteligencia Artificial verdaderamente responsable

La Inteligencia Artificial (IA) está transformando la economía, los negocios, los servicios públicos y la vida cotidiana. Sin embargo, su potencial de impacto también implica riesgos significativos para los derechos humanos, la equidad, la privacidad y la cohesión social. No se trata solo de errores técnicos, sino de consecuencias éticas que pueden afectar profundamente a personas y comunidades.

Por ello, las organizaciones líderes deben adoptar una gobernanza ética de la IA que combine visión estratégica, innovación responsable y mecanismos operativos para anticipar, detectar y corregir riesgos éticos. En este artículo exploramos las principales estrategias de mitigación ética en Inteligencia Artificial, agrupadas en enfoques proactivos y reactivos que, en conjunto, conforman una práctica integral de IA Responsable.

La inteligencia artificial (IA) es una de las tecnologías más disruptivas y transformadoras de la actualidad, y su impacto en las empresas es cada vez más significativo. Según el Índice de Inteligencia Artificial de Stanford, la adopción de la IA está en constante crecimiento, y las empresas que no se adapten a esta tendencia peligran quedarse atrás. En este artículo, exploraremos 5 perspectivas críticas que replantean la estrategia tecnológica empresarial y que son fundamentales para que las empresas puedan aprovechar al máximo el potencial de la IA.

La inteligencia artificial (IA) es un campo de la informática que se enfoca en el desarrollo de algoritmos y técnicas que permiten a las máquinas realizar tareas que normalmente requieren la inteligencia humana. Estas tareas pueden incluir desde el reconocimiento de patrones y la toma de decisiones hasta la comprensión del lenguaje y la visión. La IA ha evolucionado significativamente en las últimas décadas, pasando de ser una disciplina académica a una herramienta clave en la industria y la sociedad.