Estados Unidos activa la estandarización global de los agentes de IA: el nuevo marco que redefinirá la gobernanza autónoma

El National Institute of Standards and Technology (NIST) ha dado un paso estratégico que puede redefinir el desarrollo de la inteligencia artificial en la próxima década: la activación formal de su AI Agent Standards Initiative, un programa orientado a crear estándares interoperables y seguros para los sistemas de IA autónomos.

La decisión llega en un momento en el que los agentes inteligentes han evolucionado desde simples asistentes conversacionales hacia sistemas capaces de ejecutar tareas complejas, interactuar con múltiples entornos digitales y operar con niveles crecientes de autonomía. La cuestión ya no es si los agentes serán parte de la infraestructura empresarial, sino bajo qué reglas lo harán.

De la experimentación a la infraestructura crítica

Durante los últimos años, la adopción de modelos generativos ha estado centrada en productividad y automatización. Sin embargo, el salto hacia arquitecturas agentivas —capaces de tomar decisiones encadenadas y ejecutar acciones sin supervisión continua— introduce nuevos riesgos operativos.

Un agente puede hoy reservar vuelos corporativos, gestionar pagos, modificar configuraciones en la nube o interactuar con bases de datos estratégicas. En ese escenario, la ausencia de estándares comunes de identidad, autorización y trazabilidad se convierte en un desafío estructural.

El NIST ha identificado esta transición como un punto de inflexión: la autonomía necesita un marco técnico de confianza.

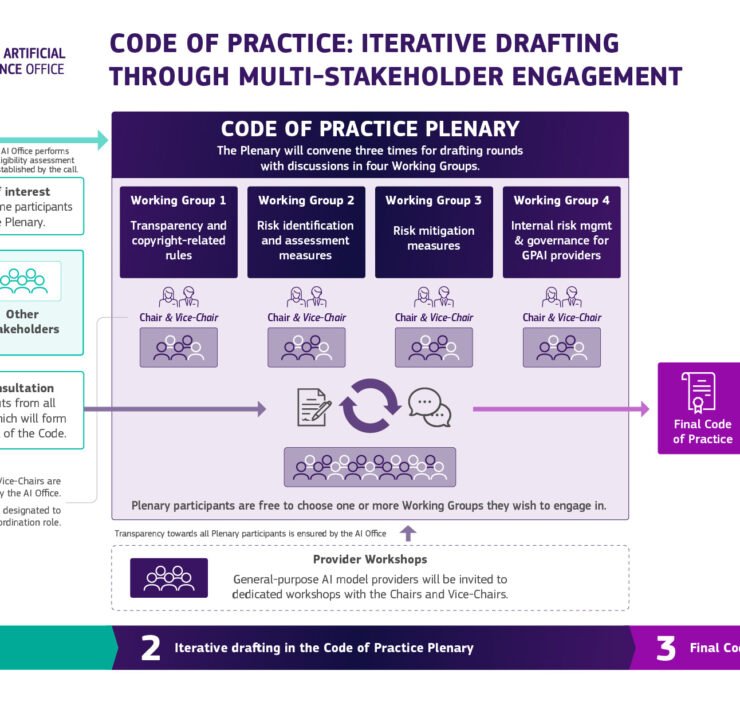

Los cinco pilares del nuevo marco

La iniciativa presentada por el organismo estadounidense se articula en torno a varios ejes fundamentales.

Interoperabilidad técnica.

El objetivo es evitar la fragmentación del ecosistema. Cada proveedor de agentes define actualmente sus propios protocolos. La estandarización permitiría que distintos sistemas dialoguen bajo reglas comunes, reduciendo dependencia tecnológica y favoreciendo arquitecturas abiertas.

Identidad y autorización de agentes.

Un agente no es un usuario humano, pero debe contar con una identidad verificable, permisos delimitados y mecanismos de revocación inmediata. El NIST trabaja en lineamientos que estructuren la autenticación y gestión de privilegios como elemento central del control de riesgos.

Auditoría y trazabilidad.

En entornos corporativos, la gobernanza exige responder a preguntas críticas: qué hizo el agente, cuándo y bajo qué contexto. La iniciativa impulsa la creación de registros estructurados, conservación de metadatos de decisión y sistemas auditables que permitan responsabilidad operativa.

Seguridad y resiliencia.

Los agentes amplían la superficie de ataque. Desde técnicas de prompt injection hasta manipulación de contexto o escalada de privilegios, el marco busca integrar medidas de seguridad desde el diseño.

Supervisión humana estructurada.

La autonomía no implica ausencia de control. El enfoque evoluciona hacia modelos con puntos de intervención configurables, umbrales de riesgo y mecanismos automáticos de pausa y escalado.

Un movimiento con alcance geopolítico

Más allá de su dimensión técnica, la iniciativa tiene un componente estratégico. Históricamente, los estándares impulsados por el NIST han servido como referencia para marcos regulatorios y políticas públicas internacionales.

Si la AI Agent Standards Initiative se consolida como base de referencia, su impacto se extenderá a:

- Procesos de contratación pública.

- Requisitos de cumplimiento en sectores regulados.

- Criterios de evaluación en grandes corporaciones.

- Futuras normativas multilaterales.

En un contexto global donde distintas potencias compiten por definir la arquitectura normativa de la IA, este movimiento posiciona a Estados Unidos como actor clave en la gobernanza de la autonomía digital.

Implicaciones para empresas y directivos

Para las organizaciones que ya están desplegando agentes, la recomendación es anticiparse. El nuevo marco sugiere revisar:

- Mapas de privilegios y accesos.

- Arquitectura de logs y sistemas de auditoría.

- Políticas de revocación y contingencia.

- Evaluación técnica de proveedores.

El impacto no será inmediato en forma de obligación legal universal, pero sí marcará una línea de referencia que influirá en contratos, certificaciones y procesos de compliance.

La nueva etapa: IA regulada por diseño

La activación de esta iniciativa refleja un cambio de enfoque en el ecosistema tecnológico. El debate ya no gira únicamente en torno a capacidades y eficiencia, sino alrededor de confianza institucional, responsabilidad operativa y sostenibilidad a largo plazo.

La autonomía sin gobernanza genera fricción; la autonomía con estándares genera escalabilidad.

Con esta iniciativa, el NIST envía un mensaje claro al mercado: la próxima fase de la inteligencia artificial será menos experimental y más estructural. Y en esa transición, los agentes dejarán de ser herramientas aisladas para convertirse en componentes críticos de la arquitectura digital empresarial.

La estandarización no representa una barrera al avance tecnológico. Representa la condición necesaria para que la IA autónoma pueda integrarse, con garantías, en los sistemas que sostienen la economía digital global.

Share/Compártelo

- Compartir en LinkedIn (Se abre en una ventana nueva) LinkedIn

- Compartir en WhatsApp (Se abre en una ventana nueva) WhatsApp

- Comparte en Facebook (Se abre en una ventana nueva) Facebook

- Compartir en X (Se abre en una ventana nueva) X

- Compartir en Threads (Se abre en una ventana nueva) Threads

- Enviar un enlace a un amigo por correo electrónico (Se abre en una ventana nueva) Correo electrónico

- Imprimir (Se abre en una ventana nueva) Imprimir

- Más

Relacionado

Descubre más desde THE INTELLIGENCE

Suscríbete y recibe las últimas entradas en tu correo electrónico.