“Deuda de Gobernanza”: las empresas están desplegando IA autónoma más rápido que su control

Durante los últimos tres años, la inteligencia artificial ha pasado de ser una herramienta de apoyo analítico a convertirse en un sistema operativo invisible dentro de las organizaciones. Hoy interviene en decisiones comerciales, procesos financieros, logística, marketing, contratación de personal e incluso en la relación directa con clientes.

La nueva generación de sistemas —especialmente los agentes autónomos y las arquitecturas basadas en modelos generativos— no solo analiza información, sino que actúa sobre ella: toma decisiones, ejecuta procesos y desencadena acciones en otros sistemas.

El problema que empieza a aparecer en muchas empresas es que la velocidad de implantación tecnológica está superando la capacidad de supervisión corporativa.

Diversos análisis de consultoras como EY muestran que muchas organizaciones están desplegando soluciones de IA en operaciones críticas mientras sus estructuras de control, auditoría y gobernanza aún siguen diseñadas para sistemas tradicionales de software.

Esto está generando un fenómeno emergente en el mundo empresarial: la deuda de gobernanza en inteligencia artificial.

La transición hacia sistemas autónomos

Hasta hace pocos años, la inteligencia artificial en la empresa funcionaba principalmente como herramienta de análisis:

- modelos de predicción de demanda

- motores de recomendación

- detección de fraude

- análisis de datos

El salto actual consiste en que la IA empieza a convertirse en sistemas de decisión automatizada.

Por ejemplo:

- plataformas que fijan precios dinámicamente sin intervención humana

- agentes que responden a clientes y negocian condiciones

- sistemas que optimizan rutas logísticas en tiempo real

- algoritmos que filtran candidatos en procesos de selección

En este contexto, las decisiones no siempre pasan por supervisión humana directa.

Y esto introduce nuevas capas de riesgo organizativo.

El problema de la trazabilidad

Uno de los primeros desafíos es la dificultad para reconstruir cómo una IA tomó una decisión.

Los sistemas de aprendizaje automático, especialmente los basados en redes neuronales profundas o modelos generativos, operan mediante estructuras matemáticas complejas que no siempre permiten explicar fácilmente el proceso interno.

Esto genera preguntas clave para las empresas:

- ¿Por qué se rechazó a un candidato en un proceso de selección?

- ¿Por qué el sistema negó un crédito a un cliente?

- ¿Por qué el algoritmo fijó un precio concreto en un momento determinado?

Cuando estas decisiones tienen impacto económico, legal o reputacional, la empresa debe poder justificarlas.

Si no puede hacerlo, aparecen riesgos regulatorios.

Responsabilidad legal en decisiones automatizadas

Otro desafío crítico es la atribución de responsabilidad.

Si un sistema de inteligencia artificial toma una decisión incorrecta que provoca daños, surgen preguntas jurídicas complejas:

- ¿Es responsable el proveedor del modelo?

- ¿Es responsable el equipo técnico que lo integró?

- ¿Es responsable el directivo que aprobó su implantación?

- ¿O lo es la empresa como entidad jurídica?

Las nuevas normativas sobre inteligencia artificial —como el reglamento impulsado por la European Union— empiezan a exigir mecanismos de supervisión, documentación y control de los sistemas de IA utilizados por las empresas.

Esto obliga a las organizaciones a adoptar estructuras de gobernanza similares a las que ya existen para:

- riesgos financieros

- cumplimiento normativo

- ciberseguridad

Riesgos operativos invisibles

La introducción de IA autónoma también puede crear riesgos operativos difíciles de detectar.

Algunos ejemplos reales en el sector tecnológico incluyen:

- algoritmos de precios que generan fluctuaciones inesperadas en el mercado

- sistemas de atención al cliente que producen respuestas inadecuadas

- modelos de predicción que introducen sesgos sistemáticos en decisiones comerciales

Cuando estos sistemas están conectados a múltiples plataformas internas, el impacto puede multiplicarse.

Un error en un modelo de IA puede propagarse rápidamente a:

- sistemas de facturación

- plataformas de comercio electrónico

- CRM corporativos

- herramientas de marketing automatizado

El riesgo reputacional

El riesgo reputacional es quizás el más visible.

Los casos de decisiones automatizadas consideradas injustas o discriminatorias se han convertido en crisis públicas para varias empresas tecnológicas y financieras.

En la era de las redes sociales, una decisión algorítmica percibida como injusta puede provocar:

- pérdida de confianza de clientes

- cobertura mediática negativa

- presión regulatoria

- daño a la marca corporativa

Por esta razón, cada vez más consejos de administración consideran que la gobernanza de la inteligencia artificial es un asunto estratégico, no solo técnico.

La aparición de la “deuda de gobernanza”

El concepto de deuda de gobernanza en IA describe una situación en la que:

- la tecnología se implanta rápidamente

- los procesos de supervisión llegan después

Es un fenómeno similar a la conocida deuda técnica en software, pero aplicado a la gestión organizativa.

La deuda de gobernanza aparece cuando las empresas:

- implementan modelos sin auditorías formales

- no documentan decisiones algorítmicas

- carecen de comités de supervisión de IA

- no realizan evaluaciones éticas o regulatorias

A corto plazo esto permite avanzar rápido.

A medio plazo puede generar problemas regulatorios, financieros y reputacionales.

Cómo están respondiendo las empresas más avanzadas

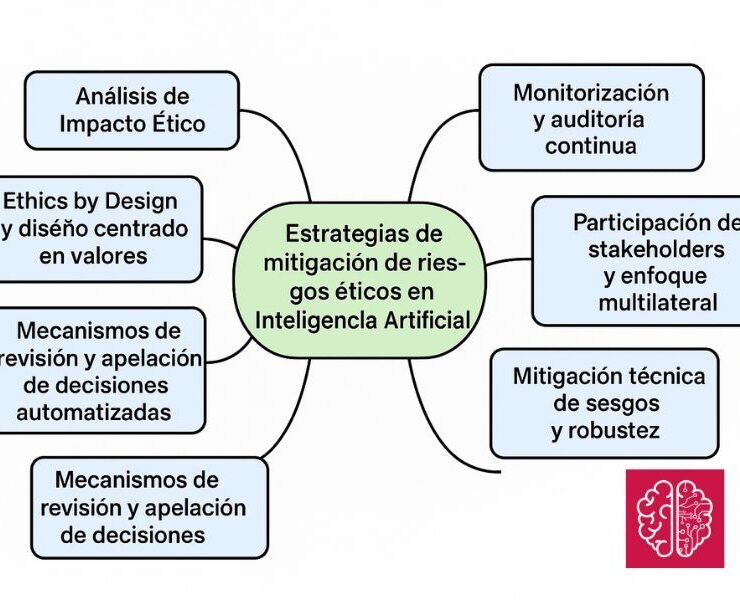

Las organizaciones que lideran la adopción responsable de inteligencia artificial están creando nuevas estructuras de control.

Entre ellas destacan:

1. Comités de gobernanza de IA en el consejo de administración

Supervisan el uso estratégico de la tecnología.

2. Auditorías internas de algoritmos

Revisan el funcionamiento, sesgos y riesgos de los modelos.

3. Sistemas de trazabilidad algorítmica

Permiten reconstruir decisiones tomadas por IA.

4. Políticas de supervisión humana

Garantizan que ciertos procesos siempre tengan intervención humana.

5. Evaluaciones de impacto ético y regulatorio

Estos mecanismos están empezando a convertirse en parte del nuevo estándar de gestión empresarial en la era de la inteligencia artificial.

Una cuestión estratégica para los directivos

Para los equipos directivos, el reto no consiste en frenar la adopción de IA, sino en equilibrar innovación y control.

Las empresas que logren este equilibrio podrán:

- escalar el uso de inteligencia artificial con seguridad

- evitar conflictos regulatorios

- mantener la confianza del mercado

En cambio, las organizaciones que adopten IA sin estructuras de gobernanza adecuadas corren el riesgo de encontrarse con sistemas críticos que ya no controlan completamente.

Y en un entorno empresarial cada vez más automatizado, controlar los sistemas que toman decisiones se convertirá en uno de los elementos centrales del liderazgo corporativo.

Share/Compártelo

- Compartir en LinkedIn (Se abre en una ventana nueva) LinkedIn

- Compartir en WhatsApp (Se abre en una ventana nueva) WhatsApp

- Comparte en Facebook (Se abre en una ventana nueva) Facebook

- Compartir en X (Se abre en una ventana nueva) X

- Compartir en Threads (Se abre en una ventana nueva) Threads

- Enviar un enlace a un amigo por correo electrónico (Se abre en una ventana nueva) Correo electrónico

- Imprimir (Se abre en una ventana nueva) Imprimir

- Más

Relacionado

Descubre más desde THE INTELLIGENCE

Suscríbete y recibe las últimas entradas en tu correo electrónico.