Ética y Regulación

La inteligencia artificial ya no es una tecnología emergente reservada a departamentos técnicos o proyectos piloto. Hoy está integrada en el día a día de cualquier organización: desde el uso de asistentes como ChatGPT o Copilot, hasta sistemas de CRM con IA, herramientas de marketing automatizado o incluso simples aplicaciones de productividad en el móvil. Esto ha cambiado por completo el perímetro de riesgo de las empresas. Ya no basta con que el departamento de IT o innovación entienda la IA. Ahora, cualquier empleado que utilice un ordenador o un smartphone está interactuando, directa o indirectamente, con sistemas de inteligencia artificial. Y eso, bajo el nuevo marco normativo europeo, tiene implicaciones legales, éticas y operativas inmediatas.

Europa ha decidido actuar antes de que la inteligencia artificial evolucione sin control. El AI Act entra en su fase decisiva con un calendario claro, una estructura de supervisión activa y una presión externa que acelera su implementación.

La inteligencia artificial deja de ser un espacio experimental para convertirse en un entorno regulado donde todo debe poder explicarse, documentarse y auditarse.

El cambio no es futuro. Es presente. Y redefine, desde ahora, cómo operan las empresas que utilizan inteligencia artificial en Europa.

Diversos análisis de consultoras como EY muestran que muchas organizaciones están desplegando soluciones de IA en operaciones críticas mientras sus estructuras de control, auditoría y gobernanza aún siguen diseñadas para sistemas tradicionales de software.

Esto está generando un fenómeno emergente en el mundo empresarial: la deuda de gobernanza en inteligencia artificial.

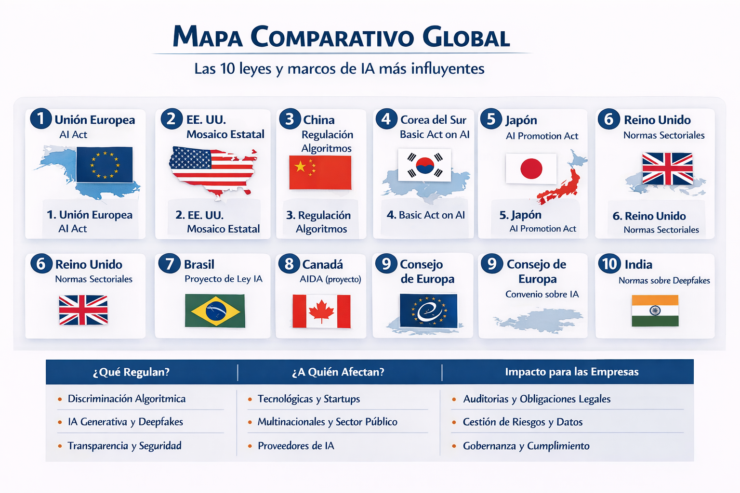

La regulación de la inteligencia artificial está entrando en una nueva fase histórica. En lugar de limitarse a recomendaciones éticas, los gobiernos están creando sistemas jurídicos completos que definen qué tipo de IA puede desarrollarse, cómo debe diseñarse y quién es responsable de sus consecuencias.

Todo indica que esta tendencia se intensificará en los próximos años. A medida que la IA se integre en sectores críticos —finanzas, defensa, sanidad, justicia—, la gobernanza tecnológica pasará a ser uno de los pilares centrales de la política económica y digital del siglo XXI.

La justicia respalda la transparencia obligatoria en inteligencia artificial y abre una nueva etapa regulatoria

Un tribunal federal de Estados Unidos ha asestado un golpe relevante a los intentos de frenar las nuevas obligaciones de transparencia en inteligencia artificial. La decisión judicial rechaza la demanda presentada por la empresa tecnológica xAI, fundada por Elon Musk, contra una ley del estado de California que exige a los desarrolladores de modelos de IA divulgar información sobre los datos utilizados para entrenar sus sistemas.

Europa entra en la fase decisiva de la regulación de la inteligencia artificial: agosto de 2026 marcará el verdadero inicio del cumplimiento empresarial

Las sanciones pueden alcanzar:

-35 millones de euros o el 7% de la facturación global anual para prácticas prohibidas

-15 millones de euros o el 3% de la facturación global por incumplimiento de obligaciones asociadas a sistemas de alto riesgo

-sanciones menores para incumplimientos administrativos o de transparencia

India refuerza su papel en la gobernanza global de la IA: de mercado emergente a arquitecto normativo.

Mientras Estados Unidos y China compiten por el liderazgo tecnológico y la Unión Europea impulsa marcos regulatorios avanzados, India propone un enfoque intermedio: innovación abierta, escalabilidad masiva y regulación pragmática adaptada a economías en desarrollo.

La transformación regulatoria más profunda del ecosistema tecnológico europeo ya tiene calendario claro. El Reglamento de Inteligencia Artificial de la Unión Europea, conocido como AI Act, avanza hacia su fase de plena aplicabilidad en agosto de 2026. No se trata de una actualización técnica más: es un rediseño estructural de cómo se desarrollan, implementan, auditan y certifican los sistemas de IA en Europa.

La norma, aprobada por el Parlamento Europeo y el Consejo de la Unión Europea, establece un enfoque basado en riesgo que clasifica los sistemas de IA en cuatro categorías: riesgo inaceptable (prohibidos), alto riesgo (sujetos a estrictas obligaciones), riesgo limitado (transparencia) y riesgo mínimo. El impacto para empresas formativas, consultoras y auditoras será estructural, especialmente en lo relativo a gobernanza, documentación técnica, trazabilidad, evaluación de conformidad y supervisión humana.

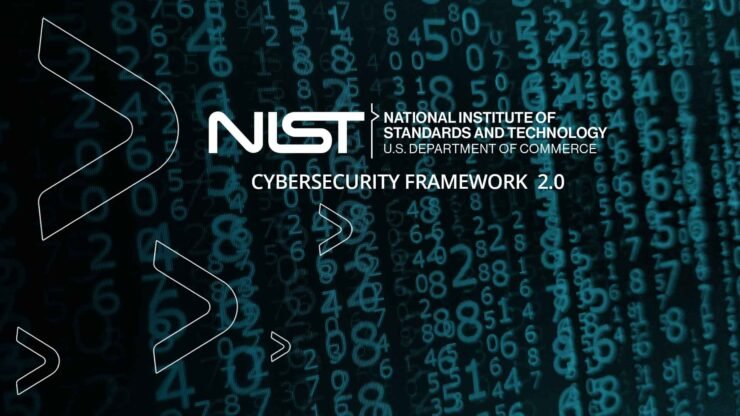

El National Institute of Standards and Technology (NIST) ha dado un paso estratégico que puede redefinir el desarrollo de la inteligencia artificial en la próxima década: la activación formal de su AI Agent Standards Initiative, un programa orientado a crear estándares interoperables y seguros para los sistemas de IA autónomos.

La decisión llega en un momento en el que los agentes inteligentes han evolucionado desde simples asistentes conversacionales hacia sistemas capaces de ejecutar tareas complejas, interactuar con múltiples entornos digitales y operar con niveles crecientes de autonomía. La cuestión ya no es si los agentes serán parte de la infraestructura empresarial, sino bajo qué reglas lo harán.

Durante años, la ética de la inteligencia artificial se abordó mediante recomendaciones, principios voluntarios y códigos de buenas prácticas impulsados por gobiernos, organismos multilaterales y las propias compañías tecnológicas. Ese ciclo ha concluido. A comienzos de 2026, la regulación de la IA entra en una nueva fase: la de la aplicación efectiva de la ley, con investigaciones formales, potenciales sanciones y un escrutinio público continuo sobre el comportamiento real de los sistemas generativos en producción.

El ejemplo más claro de este cambio de paradigma es la investigación abierta por Ofcom contra X por el comportamiento de su modelo Grok. El regulador británico evalúa si el sistema ha generado o facilitado la difusión de imágenes sexualizadas ilegales, vulnerando las obligaciones de protección establecidas en la Online Safety Act.

Este proceso marca un precedente claro: por primera vez, un regulador europeo analiza de forma estructurada la conducta de un modelo generativo concreto, no solo la plataforma que lo aloja. La IA deja de ser una “caja negra experimental” para convertirse en un objeto directo de supervisión regulatoria.

La Commission nationale de l’informatique et des libertés (CNIL) ha impuesto una multa de 1,7 millones de euros a la empresa NEXpublica France por deficiencias graves en la protección de datos personales en su plataforma PCRM, utilizada por administraciones públicas para la gestión de servicios sociales. Aunque el caso se origina en brechas de datos, su alcance va mucho más allá: anticipa cómo los reguladores europeos evaluarán la seguridad, trazabilidad y responsabilidad de los sistemas basados en inteligencia artificial en los próximos años.

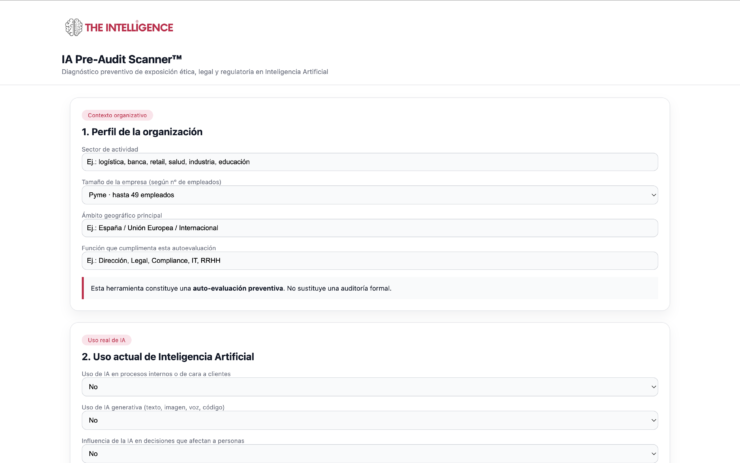

THE INTELLIGENCE INSTITUTE ha presentado IA Pre-Audit Scanner™, una herramienta digital de uso gratuito concebida para que cualquier empresa pueda conocer su situación actual en materia de uso de Inteligencia Artificial, antes de afrontar una auditoría formal o la implantación de medidas de cumplimiento.

El objetivo de la herramienta es claro: ofrecer a las organizaciones un diagnóstico preventivo, accesible y sin coste, que permita a Dirección, Legal, Compliance y TI entender cómo se está utilizando la IA, qué riesgos pueden estar latentes y qué consecuencias legales podrían activarse si no existen controles adecuados.

El enfoque del Reino Unido apunta a un cambio estructural en la forma de regular la inteligencia artificial: menos ambigüedad, más claridad normativa y una integración explícita de los derechos de propiedad intelectual en el ciclo de vida de los sistemas de IA. Este proceso se alinea con una tendencia internacional más amplia, en la que la regulación de la inteligencia artificial avanza hacia modelos más exigentes en materia de transparencia, responsabilidad y control.

Para el ecosistema europeo e internacional, los pasos dados por el Reino Unido actúan como un indicador adelantado de lo que podría convertirse en un estándar regulatorio en los próximos años. La relación entre IA y copyright deja de ser una zona gris y se encamina hacia un marco definido, con impactos directos en la innovación, la competitividad y la protección de los creadores.

La regulación europea de inteligencia artificial vuelve a moverse. La Comisión Europea presentó el 19 de noviembre una propuesta conocida como “Digital Omnibus”, un paquete legislativo diseñado para simplificar el marco digital de la Unión y ajustar varios calendarios normativos. Su elemento más llamativo: el aplazamiento hasta diciembre de 2027 de las obligaciones para los sistemas de IA catalogados como de “alto riesgo”.

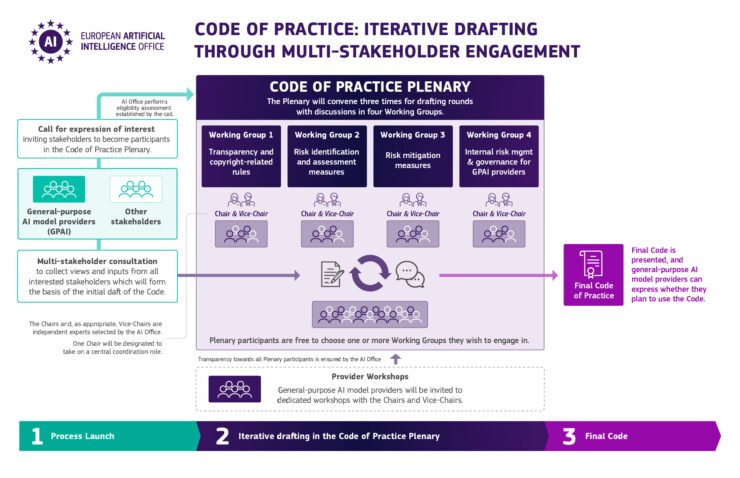

El Código, que será desarrollado con la participación de empresas tecnológicas, medios, sociedad civil y expertos independientes, busca establecer reglas claras sobre cómo deben marcarse los textos, imágenes, vídeos o audios creados o alterados mediante IA, incluyendo deepfakes y otros formatos generativos avanzados. La Comisión ha subrayado que la finalidad es doble: proteger a los usuarios frente a información manipulada y promover un entorno confiable para la innovación en IA.

La Comisión Europea se plantea modificar los plazos y requisitos de la Artificial Intelligence Act (AI Act) tras las fuertes presiones de grandes corporaciones tecnológicas y del propio gobierno de Estados Unidos. El texto legal, considerado el marco más ambicioso del mundo en materia de regulación de IA, podría sufrir un aplazamiento parcial o una aplicación más flexible para determinados sistemas catalogados como de “alto riesgo”.

Este programa de auditoría tiene como meta garantizar el cumplimiento de estándares éticos, de gobernanza de datos y de transparencia en los procesos de IA que la empresa implemente en su cadena de valor: desde el campo hasta el envasado. Con esta iniciativa, Aceite 1881 refuerza su apuesta por la innovación responsable y el liderazgo en el segmento premium de aceite de oliva virgen extra.

Con esta decisión, la empresa da un paso decisivo hacia la transparencia, seguridad y responsabilidad tecnológica, convirtiéndose en una de las primeras organizaciones del sector logístico en España en someter sus sistemas de IA a una evaluación integral bajo los estándares europeos del AI Act y todos los demás estándares internacionales.

Con este Blueprint, el Reino Unido consolida su posición como epicentro global de la IA ética y pragmática. Los AI Growth Labs representan una apuesta decidida por un modelo regulatorio que equilibra control con experimentación, innovación con responsabilidad. Si el plan logra sus objetivos, podría convertirse en un referente internacional para economías que buscan acelerar la adopción de IA sin caer en la parálisis normativa.

En un momento en que el furor por la inteligencia artificial (IA) alcanza nuevos registros en los mercados, el Fondo Monetario Internacional (FMI) ha lanzado una advertencia contundente: muchas naciones no cuentan con el marco ético ni regulatorio necesario para gestionar este salto tecnológico y podrían estar sentando las bases de una burbuja especulativa.

California se ha convertido en el primer estado de Estados Unidos en promulgar una ley específica para regular los chatbots de compañía o “AI companions”, estableciendo un marco pionero en ética, seguridad infantil y transparencia algorítmica.

La SB 243, firmada por el gobernador Gavin Newsom, obliga a los desarrolladores de este tipo de aplicaciones a declarar de forma explícita que se trata de inteligencias artificiales y a implementar medidas de protección reforzadas cuando interactúan con menores.

El documento, presentado por el Chief Administrative Judge Joseph Zayas, establece que solo se podrán emplear herramientas de IA previamente verificadas, seguras y aprobadas por el sistema judicial. Además, prohíbe expresamente la introducción de información confidencial o sensible en servicios públicos o plataformas comerciales de IA, como ChatGPT o Gemini, salvo autorización expresa.

THE INTELLIGENCE INSTITUTE anuncia el lanzamiento de su Auditoría Express en IA y Ética, un servicio integral con entrega en 72 horas diseñado para evaluar de forma rápida y rigurosa la calidad técnica, el cumplimiento normativo y el impacto ético de sistemas y proyectos de inteligencia artificial en empresas de cualquier sector.

En un contexto donde la Inteligencia Artificial se ha convertido en motor estratégico para empresas de todos los sectores, la falta de control y supervisión puede derivar en riesgos legales, reputacionales y operativos. Los algoritmos no auditados pueden introducir sesgos discriminatorios, generar decisiones opacas difíciles de justificar o incluso incumplir normativas de privacidad y protección de datos. Al mismo tiempo, clientes, reguladores e inversores empiezan a exigir evidencias de un uso responsable de la IA.