Los 5 riesgos reales que ya están apareciendo en empresas que usan inteligencia artificial

La adopción empresarial de la inteligencia artificial está creciendo a gran velocidad, pero este avance también está generando nuevos riesgos operativos, legales y estratégicos. Muchas organizaciones están descubriendo que los problemas no aparecen en el desarrollo de los modelos, sino cuando la tecnología se integra en procesos reales de negocio. Estos son cinco de los riesgos que ya están emergiendo en compañías que utilizan inteligencia artificial a gran escala.

1. Decisiones automatizadas difíciles de explicar

Uno de los primeros desafíos que están encontrando las empresas es la dificultad para explicar cómo un sistema de inteligencia artificial llega a determinadas conclusiones. Muchos modelos avanzados funcionan como “cajas negras”: generan resultados correctos, pero no siempre es sencillo entender el razonamiento que hay detrás.

Esto se vuelve especialmente problemático cuando la inteligencia artificial participa en decisiones sensibles, como la concesión de créditos, la selección de candidatos en procesos de contratación o la evaluación de riesgos financieros. Si una empresa no puede explicar cómo funciona el sistema, puede enfrentarse a cuestionamientos legales, regulatorios o reputacionales.

En Europa, el marco regulatorio establecido por el AI Act exige que determinados sistemas de alto riesgo dispongan de mecanismos de transparencia y trazabilidad que permitan auditar sus decisiones.

2. Sesgos algorítmicos que generan discriminación

La inteligencia artificial aprende a partir de datos históricos. Si esos datos contienen sesgos sociales, culturales o económicos, el algoritmo puede reproducirlos o incluso amplificarlos.

Esto ya ha ocurrido en sistemas de selección de personal, donde algunos modelos penalizaban indirectamente a ciertos perfiles profesionales, o en herramientas de análisis crediticio que replicaban desigualdades presentes en los datos históricos.

El problema no siempre es evidente al principio, pero cuando emerge puede tener consecuencias reputacionales importantes para la empresa.

3. Uso indebido de datos o problemas de privacidad

Muchos proyectos de inteligencia artificial requieren grandes volúmenes de datos para entrenar modelos y mejorar su precisión. Sin embargo, en algunos casos las organizaciones descubren tarde que los datos utilizados incluyen información sensible o protegida.

Entre los riesgos más frecuentes aparecen el uso de datos personales sin base legal suficiente, la incorporación de información confidencial en modelos externos o la exposición accidental de datos empresariales en herramientas de IA generativa.

Esto obliga a reforzar las políticas de gobernanza de datos y la supervisión sobre qué información se utiliza para entrenar o alimentar sistemas de inteligencia artificial.

4. Dependencia tecnológica de proveedores externos

Otro riesgo creciente es la dependencia de plataformas tecnológicas externas para desarrollar o ejecutar soluciones de inteligencia artificial.

Muchas empresas utilizan modelos, APIs o infraestructuras de terceros. Esto permite avanzar rápido, pero también genera nuevas dependencias estratégicas. Si un proveedor cambia condiciones, modifica su modelo de negocio o introduce limitaciones técnicas, la empresa puede quedar expuesta.

Además, algunas organizaciones están descubriendo que no tienen control total sobre cómo funcionan los modelos que utilizan.

5. Automatización mal supervisada que genera errores operativos

La inteligencia artificial puede automatizar procesos complejos, pero si se implementa sin suficiente supervisión humana puede provocar errores en cadena.

Esto puede ocurrir, por ejemplo, en sistemas de atención al cliente, en herramientas de generación automática de contenido o en modelos de predicción de demanda. Si el sistema produce resultados incorrectos y nadie los supervisa, el impacto puede extenderse rápidamente a toda la organización.

Por esta razón, cada vez más empresas están adoptando el principio de supervisión humana obligatoria en procesos críticos, especialmente cuando las decisiones afectan a clientes, empleados o aspectos financieros.

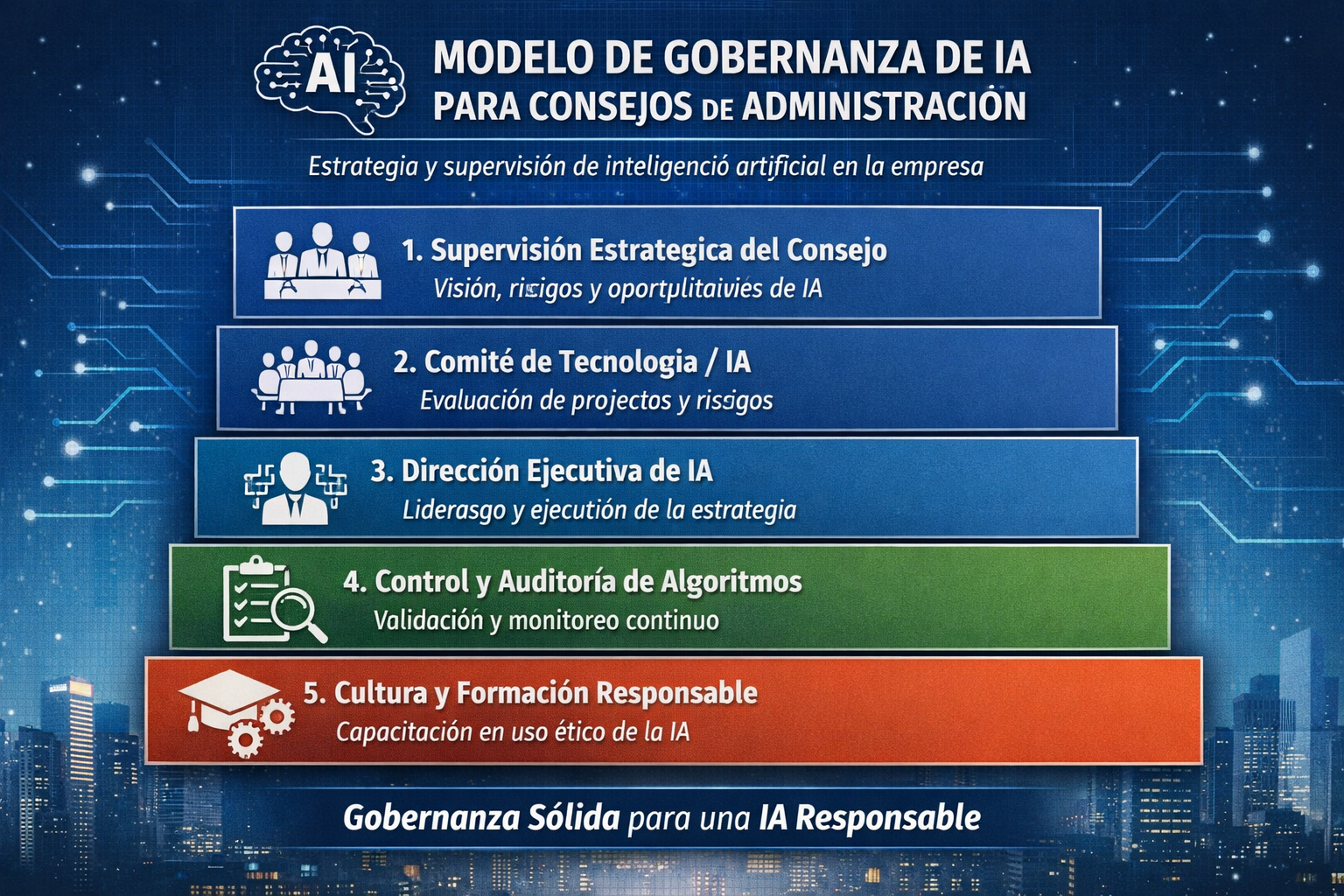

Un modelo de gobernanza de IA para consejos de administración

A medida que la inteligencia artificial se convierte en una tecnología estratégica para las empresas, su supervisión está pasando del ámbito técnico al ámbito del gobierno corporativo. Los consejos de administración comienzan a asumir la responsabilidad de supervisar cómo se utiliza esta tecnología dentro de la organización.

Un modelo de gobernanza de IA para el consejo puede estructurarse en cinco niveles.

1. Supervisión estratégica desde el consejo de administración

El consejo debe asumir que la inteligencia artificial es una cuestión estratégica y no solo tecnológica. Esto implica revisar periódicamente la estrategia de IA de la empresa, analizar las oportunidades de creación de valor y evaluar los riesgos asociados a su uso.

El consejo no necesita conocer los detalles técnicos de los modelos, pero sí debe entender cómo influyen en el negocio y qué riesgos pueden generar.

2. Comité especializado en tecnología o inteligencia artificial

Muchas compañías están creando comités específicos dentro del consejo dedicados a tecnología, digitalización o inteligencia artificial. Este comité se encarga de revisar proyectos relevantes, analizar riesgos emergentes y coordinar la supervisión de iniciativas tecnológicas.

Su función principal es servir como puente entre el consejo de administración y los equipos técnicos de la empresa.

3. Dirección ejecutiva responsable de la estrategia de IA

A nivel ejecutivo, cada vez es más frecuente la aparición de nuevas figuras directivas como Chief AI Officer o responsables de estrategia de inteligencia artificial.

Estas posiciones coordinan los proyectos de IA, definen prioridades de inversión y garantizan que las iniciativas tecnológicas estén alineadas con la estrategia corporativa.

También actúan como enlace entre los equipos técnicos y la alta dirección.

4. Marco de control y auditoría de algoritmos

La gobernanza de la inteligencia artificial requiere mecanismos específicos de control. Esto incluye auditorías de algoritmos, evaluación de riesgos antes de desplegar modelos y sistemas de monitorización continua.

Las empresas más avanzadas están implantando registros internos de sistemas de IA donde se documentan los modelos utilizados, los datos empleados y los riesgos identificados.

Este tipo de documentación será cada vez más importante en contextos regulatorios.

5. Cultura organizativa y formación en IA responsable

La gobernanza de la inteligencia artificial no depende solo de estructuras formales. También requiere que los empleados comprendan los riesgos asociados a esta tecnología.

Muchas organizaciones están desarrollando programas de formación en uso responsable de la inteligencia artificial para directivos, equipos técnicos y personal operativo.

El objetivo es que la innovación tecnológica avance dentro de un marco de responsabilidad y control.

La nueva responsabilidad del liderazgo empresarial

Durante décadas, la supervisión tecnológica se delegaba casi por completo en departamentos de IT. Con la inteligencia artificial, esta dinámica está cambiando.

Hoy el uso de algoritmos puede afectar a decisiones estratégicas, reputación corporativa, cumplimiento normativo y relación con clientes. Por esta razón, los consejos de administración están empezando a integrar la gobernanza de la inteligencia artificial dentro de sus responsabilidades habituales.

Las empresas que desarrollen estructuras sólidas de supervisión podrán avanzar con mayor confianza en la adopción de esta tecnología y aprovechar todo su potencial sin exponerse a riesgos innecesarios.

Share/Compártelo

- Compartir en LinkedIn (Se abre en una ventana nueva) LinkedIn

- Compartir en WhatsApp (Se abre en una ventana nueva) WhatsApp

- Comparte en Facebook (Se abre en una ventana nueva) Facebook

- Compartir en X (Se abre en una ventana nueva) X

- Compartir en Threads (Se abre en una ventana nueva) Threads

- Enviar un enlace a un amigo por correo electrónico (Se abre en una ventana nueva) Correo electrónico

- Imprimir (Se abre en una ventana nueva) Imprimir

- Más

Relacionado

Descubre más desde THE INTELLIGENCE

Suscríbete y recibe las últimas entradas en tu correo electrónico.